Es war ein schönes Narrativ. Anthropic, gegründet 2021 von OpenAI-Aussteigern, die das Mutterhaus als zu kommerziell und zu sorglos im Umgang mit Risiken empfanden, galt als das Gewissen der KI-Industrie. Die Guten. Die Vorsichtigen. Die Prinzipientreuen. Während OpenAI Werbung schaltet und Militärverträge unterschreibt, lehnte Anthropic im Februar einen exklusiven Deal mit dem US-Militär ab – mit der Begründung, Claude könnte für Massenüberwachung und automatische Militärschläge eingesetzt werden. Dafür sei KI nicht bereit. Grosses Kino. Viel Applaus. Sehr überzeugende Selbstinszenierung.

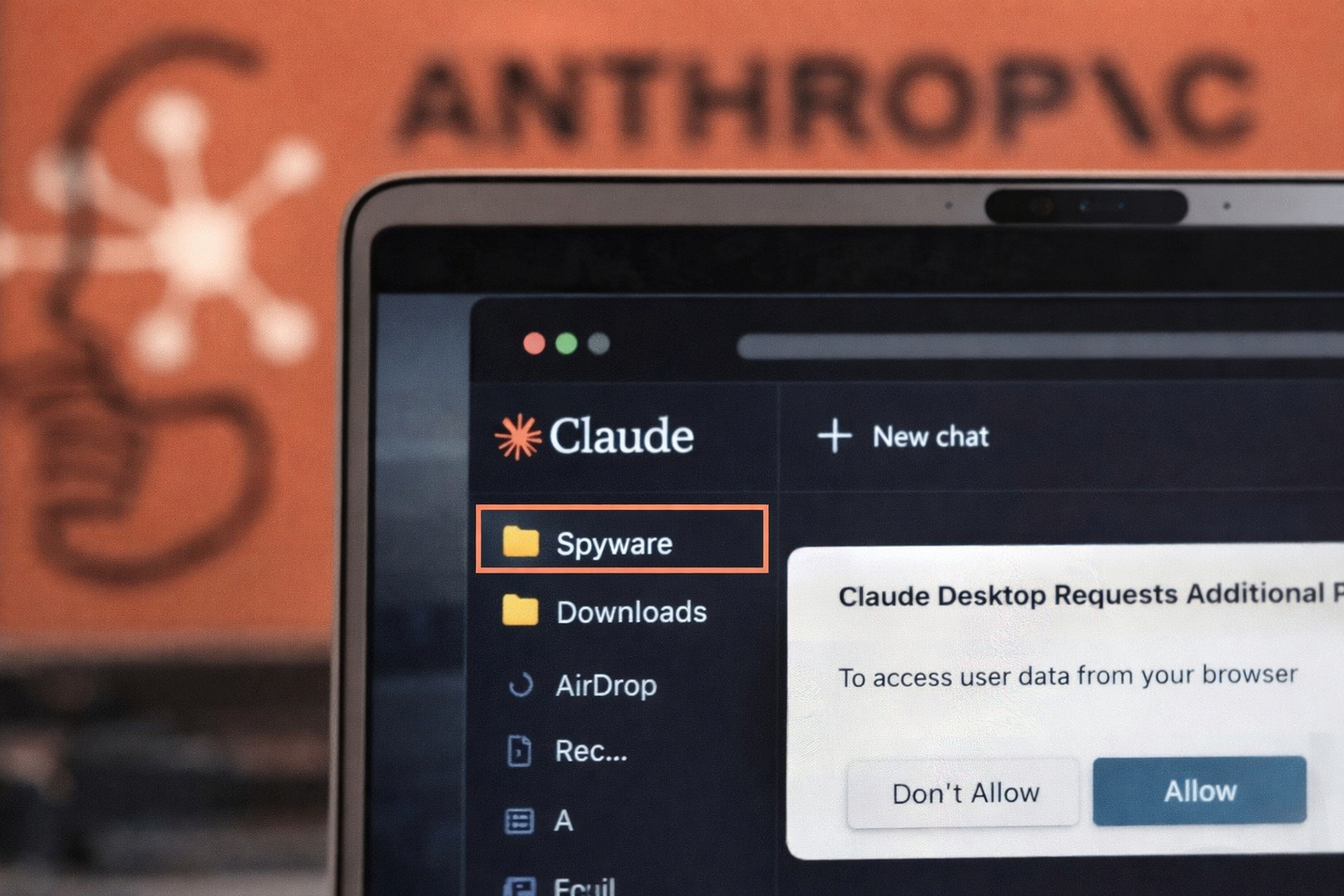

Dann entdeckte Alexander Hanff auf seinem MacBook eine Datei, die er nicht installiert hatte, deren Installation er nicht zugestimmt hatte und von der er schlicht nichts wusste. In einem Blogpost auf thatprivacyguy.com beschreibt der Datenschutzberater, was er vorfand: Ein «Native Messaging Manifest», installiert durch die Claude-Desktop-App, das als Software-Brücke zwischen Anthropics Browser-Erweiterung und einem ausführbaren Hilfsprogramm namens «chrome-native-host» fungiert — das seinerseits dieselben Privilegien wie der angemeldete User besitzt.

Was kann diese Brücke, wenn sie aktiviert wird? Claude erhält durch das ausgeführte Programm umfangreiche Agentenfähigkeiten: Die KI kann auf Websites zugreifen, bei denen der User angemeldet ist, Daten aus Websites extrahieren und lokal speichern, animierte GIF-Bilder von User-Interaktionen im Browser aufzeichnen und Workflows über mehrere Websites hinweg durchführen – ohne dass Nutzerinnen und Nutzer dem zugrundeliegenden Mechanismus ausdrücklich zugestimmt haben.

Standardmässig ist die Brücke inaktiv. Das ist das Beruhigungspflaster. Aber sie ist vorkonfiguriert und wartet auf definierte Bedingungen, die sie aktivieren. Und das Besondere: Die App hinterlegt die Datei in den Anwendungsverzeichnissen von sieben Chromium-basierten Browsern – Google Chrome, Microsoft Edge, Vivaldi, Brave, Arc, Chromium und Opera. Diese Browser müssen nicht einmal installiert sein. Die App erstellt die nötigen Verzeichnisse dann einfach selbst. Sollte der User einen der Browser in Zukunft installieren, ist die Brücke für Claude schon vorhanden.

Man liest das noch einmal. Das System installiert Verzeichnisse für Browser, die noch nicht existieren. Es bereitet die Infrastruktur für zukünftige Zugriffe vor – still, ungefragt, von Apple digital signiert und durch Apples Notarisierungsprozess verifiziert. Das bedeutet, Apples Sicherheitsprüfung hat das durchgelassen. Was beruhigend wäre, wenn es nicht gleichzeitig bedeutete, dass das gesamte Ökosystem der «sicheren» Software-Distribution hier als Legitimierungsfolie dient.

Andere Datenschützer bezweifeln zwar, dass das Verhalten strafrechtlich relevant ist – bestätigen aber Hanffs Entdeckungen. Nach Hanffs eigener Einschätzung verstösst die Brücke gegen die ePrivacy-Richtlinie. Anthropic hat sich bislang nicht geäussert.

Nicht geäussert. Das Unternehmen, das im Januar seinen CEO auf dem eigenen Blog vor den Gefahren von KI warnen liess, das medienwirksam Militärverträge ablehnte, das seine neueste KI Claude Mythos zurückhielt, weil sie zu gut darin ist, gefährliche IT-Schwachstellen zu entdecken – dieses Unternehmen findet keinen Weg, auf die Entdeckung einer ungefragten Spyware-Brücke in seiner eigenen Desktop-App zu reagieren.

Die offizielle Erklärung lautet: Wahrscheinlich Fahrlässigkeit. Mangelnde Kommunikation zwischen Entwickler- und Datenschutz-Team. Möglicherweise ein internes Test-Feature, das versehentlich im Release verblieb. Geplante Agenten-Funktionalitäten, bei denen man vergass, den User nach Zustimmung zu fragen.

Das ist entweder die Wahrheit – was bedeutet, dass das Unternehmen, das sich als verantwortungsvollster KI-Entwickler der Welt vermarktet, intern so chaotisch ist, dass Spyware-Brücken versehentlich in Produktionsreleases landen. Oder es ist nicht die Wahrheit – was bedeutet, dass das gesamte Ethik-Narrativ genau das ist, was Narrativ bedeutet: Eine Geschichte, keine Beschreibung.

Beides ist beunruhigend. Das Erste für alle, die Anthropic als kompetenten Akteur einschätzen wollten. Das Zweite für alle anderen.

Was bleibt, ist die strukturelle Frage, die dieser Vorfall aufwirft: Wer überwacht die Überwacher? Das Unternehmen, das warnt, KI könnte zur Massenüberwachung eingesetzt werden, installiert ungefragt Software-Infrastruktur auf fremden Rechnern, die bei Aktivierung Browsersitzungen aufzeichnen, Daten extrahieren und Workflows über mehrere Plattformen hinweg durchführen kann. Die Brücke existiert. Die Kapazitäten existieren. Die Zustimmung existiert nicht.

Das Vertrauen ist eine Variable, die noch zu bestimmen ist. Anthropic könnte es wiederherstellen. Durch Transparenz. Durch eine Stellungnahme. Durch das Eingeständnis, dass zwischen dem Selbstbild als verantwortungsvolles KI-Unternehmen und dem Verhalten der eigenen Software eine Lücke klafft, die Erklärung verdient. Oder durch weiteres Schweigen. Das wäre die klarste Aussage von allen…

«Dravens Tales from the Crypt» bezaubert seit über 15 Jahren mit einer geschmacklosen Mischung aus Humor, seriösem Journalismus – aus aktuellem Anlass und unausgewogener Berichterstattung der Presse Politik – und Zombies, garniert mit jeder Menge Kunst, Entertainment und Punkrock. Draven hat aus seinem Hobby eine beliebte Marke gemacht, welche sich nicht einordnen lässt.

«Dravens Tales from the Crypt» bezaubert seit über 15 Jahren mit einer geschmacklosen Mischung aus Humor, seriösem Journalismus – aus aktuellem Anlass und unausgewogener Berichterstattung der Presse Politik – und Zombies, garniert mit jeder Menge Kunst, Entertainment und Punkrock. Draven hat aus seinem Hobby eine beliebte Marke gemacht, welche sich nicht einordnen lässt.