Alle Tools, die dafür nötig sind, sind öffentlich verfügbar und auch für Amateure einfach zu bedienen. Filmszenen aller Art lassen sich manipulieren und die Gesichter der Schauspieler austauschen. Ein Reddit-Nutzer baute die Leia-Szene aus Rogue One damit nach, ganz ohne 200-Millionen-Dollar-Budget. Die Technologie könnte ernste Konsequenzen haben.

Nachdem ein einzelner Redditor vor zwei Monaten mit seinen täuschend echten Porno-Fakes von Gal Gadot und anderen Stars und Sternchen für Aufsehen sorgte, ist auf Reddit daraus eine ganze Szene entstanden. Das Subreddit r/deepfakes hat inzwischen über 38’000 Mitglieder, von denen viele selbst Pornos manipulieren, in dem sie einen vorhandenen Film mit der Hilfe einer KI mit beliebigen Gesichtern versehen. Dafür brauchen sie nur genügend Bilder von ihrer ahnungslosen Zielperson und ein paar öffentlich verfügbare Tools. Ein Redditor hat sogar eine App gebastelt, mit der auch blutige Anfänger KI-gestützte Pornos erstellen können.

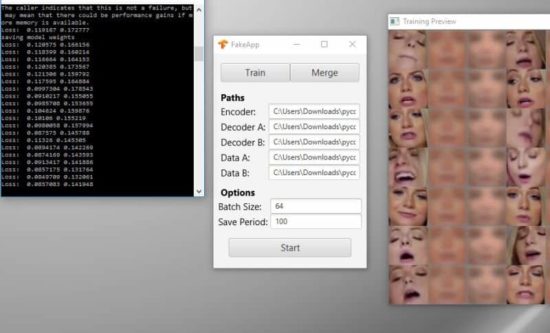

Redditor deepfakeapp entwickelte die sogenannte FakeApp, eine benutzerfreundliche Anwendung, mit der jeder Pornos manipulieren kann. «Ich halte die aktuelle Version der App für einen guten Ausgangspunkt, aber ich hoffe, dass ich sie in den kommenden Tagen und Monaten noch weiter verbessern kann», sagte er. «Ich möchte erreichen, dass Nutzer einfach ein Video von ihrem Computer auswählen, ein neuronales Netzwerk runterladen, das mit einem bestimmten Bilderdatensatz aus einem öffentlichen Archiv gefüttert wird und das Gesicht im Video dann mit einem Knopfdruck austauschen können.»

Redditor UnobtrusiveBot hat das Gesicht von Jessica Alba beispielsweise mithilfe der FakeApp auf den Körper von Pornodarstellerin Melanie Rios platziert. «Ging super schnell – ich lerne gerade, wie ich das Modell neu trainieren kann. Es hat etwa fünf Stunden gedauert – nicht schlecht für das Ergebnis», schrieb er in einem Kommentar. Auch Redditor nuttynutter6969 nutzte die FakeApp um die Star-Wars-Darstellerin Daisy Ridley zum unfreiwilligen Pornostar werden zu lassen.

Die meisten Posts in r/deepfakes sind pornografischer Natur, aber einige Nutzer erstellen auch Videos, die Beweisen, dass der Technologie eigentlich keine Grenzen gesetzt sind, wenn man nur über die passenden Rohdaten verfügt. Der Redditor Z3ROCOOL22 kombinierte beispielsweise Aufnahmen von Hitler mit dem argentinischen Präsidenten Mauricio Macri. Laut deepfakeapp kann jeder, der FakeApp herunterlädt und über ein bis zwei qualitativ hochwertige Videos seiner Zielperson verfügt, realistische Filmchen erstellen.

Man brauche lediglich einen guten Grafikprozessor mit CUDA-Support. Nutzer, die nicht über den richtigen Prozessor verfügen, können dafür auch Cloud-basierte Dienste wie Google Cloud Platform nutzen. Der gesamte Prozess von der Datenextraktion, über die Umwandlung bis hin zum vollständigen Gesichtertausch, dauert angeblich etwa acht bis zwölf Stunden, wenn er korrekt durchgeführt wird. Einige Nutzer berichten, dass sie viel länger gebraucht haben – teilweise mit desaströsen Resultaten.

Als besonders gelungenes Beispiel nennt deepfakeapp ein Video des Nutzers derpfake, der einen FaceSwap von Prinzessin Leia aus Rogue One erstellt hat. «Oben sieht man das Original aus Rogue One mit einer seltsamen computeranimierten Carrie Fisher. Budget für den Film: 200 Millionen Dollar», beschreibt derpfake sein Video. «Unten ist die 20-minütige Manipulation, die man auch mit einer Schauspielerin hätte erstellen können, die Carrie Fisher ähnlich sieht. Mein Budget: 0 Dollar und ein paar Alben von Fleetwood Mac.» Statt das Gesicht von Prinzessin Leia kostspielig am Computer zu animieren, hatte derpfake die Software mit echten Aufnahmen der jungen Carrie Fisher gefüttert und in die Filmszenen eingefügt.

Eine Technologie, mit der jeder so kinderleicht täuschend echte Videos faken kann, und die sich so rasend schnell entwickelt, könnte ernste Auswirkungen haben. Denn der Fantasie sind keine Grenzen gesetzt: Egal, ob es sich um Rachepornos, manipulierte Aufnahmen von Stars oder politischen Reden handelt, mit den nötigen Rohdaten und ein paar Open-Source Tools kann jede Aufnahme gefälscht werden. Bald wird die Technik so gut sein, dass wir unmöglich den Unterschied zwischen einem echten Video und einem KI-generierten Fake erkennen können. Schon heute fällt es Menschen zunehmend schwer, zwischen der Wahrheit und Fake News zu unterscheiden und Nachrichten jeglicher Art verbreiten sich über Soziale Medien in Windeseile. Neu daran ist, dass die technischen Mittel nun jedem zur Verfügung stehen. Dadurch wird das ganze Prinzip von Vertrauen und Glaubwürdigkeit untermauert. Wir werden uns wohl an eine Welt gewöhnen müssen, in der solche Video-Fakes immer besser und damit auch schwerer zu erkennen werden. Inklusive der dazugehörigen Konflikte mit den Persönlichkeitsrechten der betroffenen Personen. In Zukunft könnten solche Fälschungen als Grundlage von Propaganda oder absichtlich irreführender Nachrichten benutzt werden.

«Dravens Tales from the Crypt» bezaubert seit über 15 Jahren mit einer geschmacklosen Mischung aus Humor, seriösem Journalismus – aus aktuellem Anlass und unausgewogener Berichterstattung der Presse Politik – und Zombies, garniert mit jeder Menge Kunst, Entertainment und Punkrock. Draven hat aus seinem Hobby eine beliebte Marke gemacht, welche sich nicht einordnen lässt.

«Dravens Tales from the Crypt» bezaubert seit über 15 Jahren mit einer geschmacklosen Mischung aus Humor, seriösem Journalismus – aus aktuellem Anlass und unausgewogener Berichterstattung der Presse Politik – und Zombies, garniert mit jeder Menge Kunst, Entertainment und Punkrock. Draven hat aus seinem Hobby eine beliebte Marke gemacht, welche sich nicht einordnen lässt.